¿Cuándo vamos a llamarlo, familia? ¿Cuándo vamos a admitir finalmente que los chatbots y la IA en realidad no pueden hacer el trabajo de los seres humanos? Cuántos estafas , desastres de relaciones públicas , y debacles públicas serán necesarias antes de que finalmente digamos: “Sí, ¿sabes qué? Depender de robots sin sentido para todo nuestro arte y conocimiento tal vez no sea la gran idea que pensábamos que era”.

Vídeos recomendados¿El último desastre de la IA? Bueno, tiene un par de semanas, por lo que no es tan reciente como el Imitación de Willy Wonka generada por IA , pero sigue siendo bastante sorprendente. Un hombre llamado Jake Moffatt necesitaba volar a Toronto después de la muerte de su abuela, por lo que le preguntó al chatbot de Air Canada cómo funcionaban las tasas de duelo. El chatbot le dijo que comprara un boleto a precio completo y luego solicitara un reembolso parcial dentro de los 90 días, lo cual hizo, asegurándose de tomar una captura de pantalla de las instrucciones del chatbot.

Sin embargo, cuando llegó el momento de obtener el reembolso, Air Canada le dijo a Moffatt que su chatbot estaba equivocado. Verá, la IA generativa (la tecnología detrás de cosas como los chatbots de servicio al cliente) es susceptible a lo que se llama 'alucinaciones', o información que la IA inventa. El año pasado, por ejemplo, un par de abogados se metió en una mierda profunda cuando hicieron que ChatGPT les escribiera el texto de una demanda y luego descubrieron que citaba un montón de casos judiciales que en realidad no existían. La IA no puede distinguir entre información verdadera y falsa. Todo lo que puede hacer es remezclar el texto existente en algo que suene plausible.

que significa reto en uno

Increíblemente, la aerolínea afirmó que el desastre era La culpa de Moffatt porque no había comparado las directrices del chatbot con la política oficial de la aerolínea. Según el razonamiento de la aerolínea, Moffatt debería haber sabido que no se podía confiar en la herramienta de servicio al cliente proporcionada por Air Canada. Presumiblemente, si las alas se cayeran del avión en pleno vuelo, Air Canada reprendería a los clientes por abordarlo en primer lugar.

super mario kart de la vida real

Air Canada se negó a emitir el reembolso, por lo que Moffatt llevó a la aerolínea a los tribunales y ganó. La defensa de Air Canada es incluso más absurda que su negativa inicial a conceder el reembolso. Según la aerolínea, el chatbot, que, permítanme enfatizar, la aerolínea utiliza en su propio sitio web para responder las preguntas de los clientes, es ' una entidad legal separada que es responsable de sus propias acciones”.

Si un empleado humano le dio a un cliente información falsa, entonces Air Canada podría posiblemente darle el reembolso al cliente y, a su vez, responsabilizar al empleado. ¿Pero argumentar que un robot, que no gana un sueldo y sólo hace lo que usted programa para hacer, es su propia entidad legal? Vete de aquí con eso.

¿Podríamos por favor parar? ¿Dejar de producir montañas de palabrería de IA, dejar de reemplazar humanos capaces con robots incompetentes, dejar de pretender que la IA de alguna manera mejorará la sociedad? No funciona, amigos. Cancelalo. La IA sólo empeora las cosas.

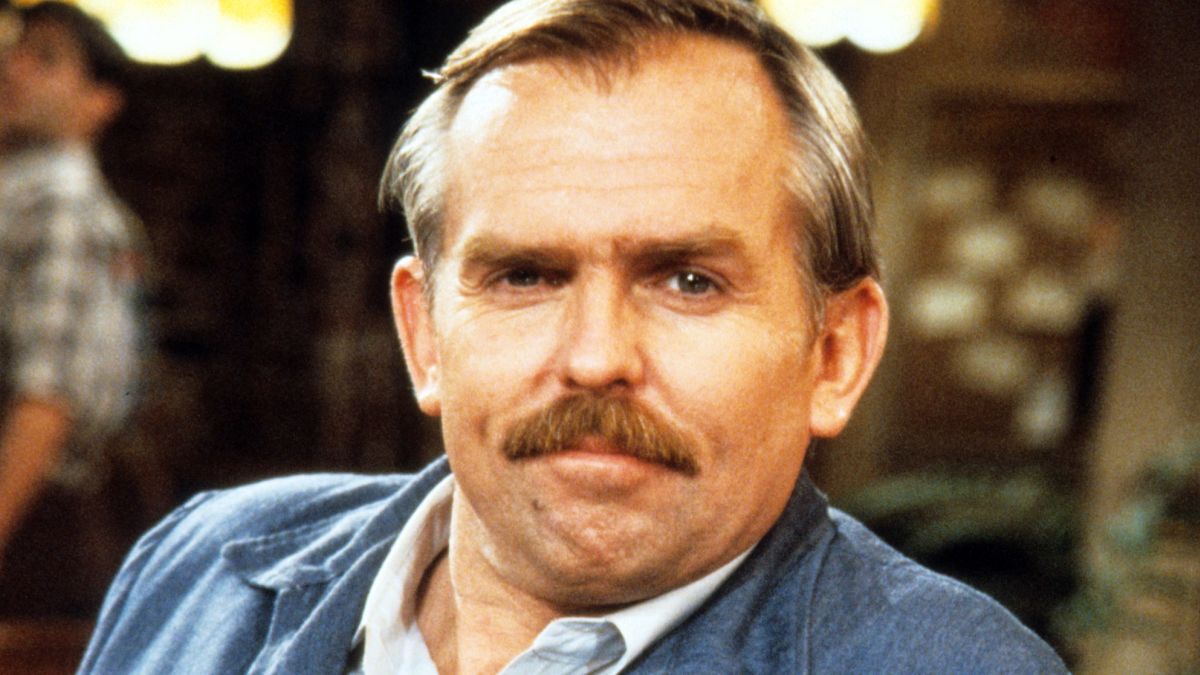

(a través de Ars Técnica , imagen destacada: Paramount Pictures)

cuantos años tienen las cartas del tarot

Autor

Julia Glassman Julia Glassman (ella/ella) tiene una maestría en Bellas Artes del Iowa Writers' Workshop y ha estado cubriendo feminismo y medios desde 2007. Como redactora del DiariodeunchicotraBajador, Julia cubre películas de Marvel, terror popular, ciencia ficción y fantasía, cine y televisión. , cómics y todo lo relacionado con la brujería. Bajo el seudónimo de Asa West, es la autora del popular fanzine 'Cinco principios de la brujería verde' (Gods & Radicals Press). Puede consultar más de sus escritos en https://juliaglassman.carrd.co/.</a>

Julia Glassman Julia Glassman (ella/ella) tiene una maestría en Bellas Artes del Iowa Writers' Workshop y ha estado cubriendo feminismo y medios desde 2007. Como redactora del DiariodeunchicotraBajador, Julia cubre películas de Marvel, terror popular, ciencia ficción y fantasía, cine y televisión. , cómics y todo lo relacionado con la brujería. Bajo el seudónimo de Asa West, es la autora del popular fanzine 'Cinco principios de la brujería verde' (Gods & Radicals Press). Puede consultar más de sus escritos en https://juliaglassman.carrd.co/.</a>

![Los traficantes de drogas que cantan y bailan en el musical de Breaking Bad Middle School [Video]](https://diariodeunchicotrabajador.com/img/breaking-bad/84/breaking-bad-middle-school-musical-s-got-singing.jpg)